Adressdaten für Enhanced Conversions nutzen: Ist das sinnvoll und wie geht es?

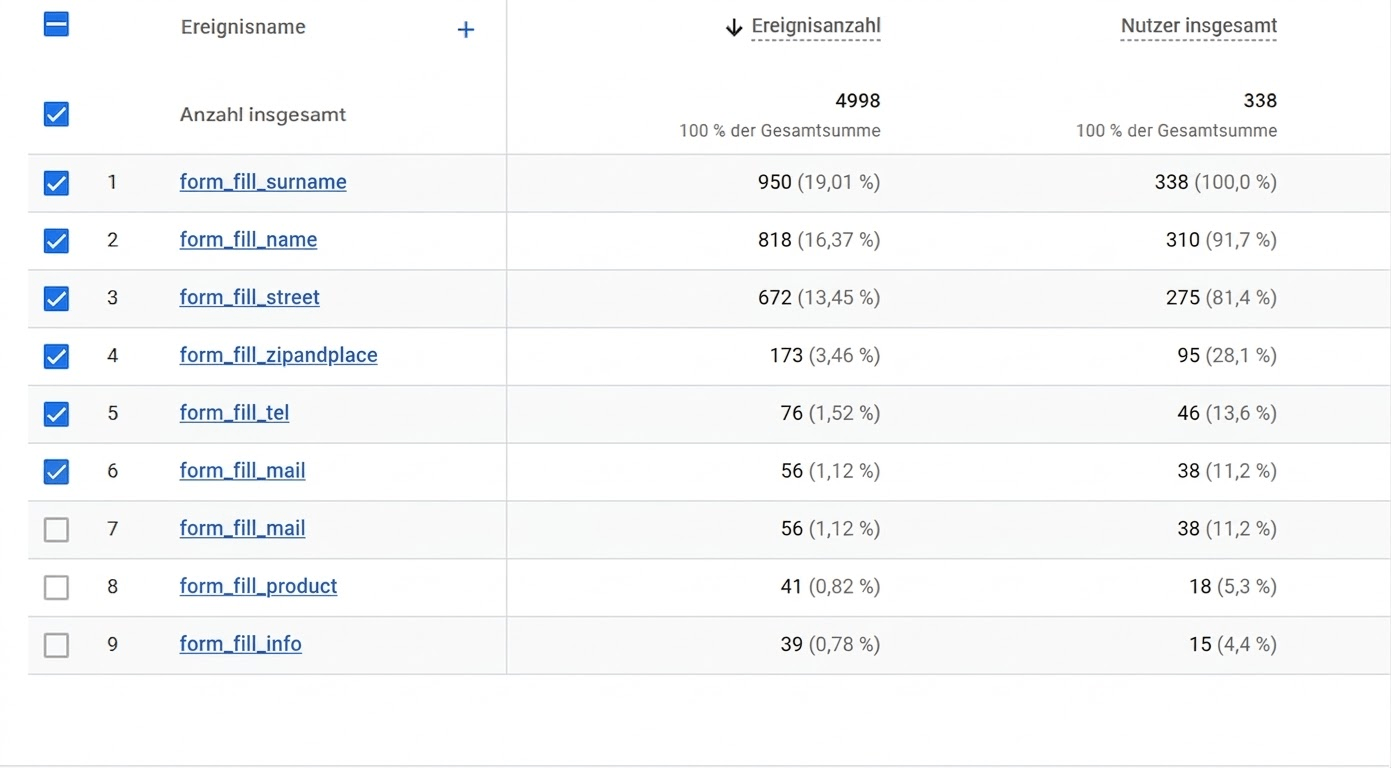

Wenn man eine Chrome Erweiterung zum Debugging von "Erweiterten Conversions" für Google Ads baut, muss man sich zwangsweise tiefer mit den Nutzerdaten auseinandersetzen, die auf unterschiedlichen Wegen zu Google Ads gelangen können. Einige Fragen, auf die ich zum Beispiel bei der Erstellung des Enhanced Conversion Data Validators gestoßen bin: Kann man tatsächlich eine Straße auch als Hash-Wert statt im Klartext im user_data Objekt übergeben? Wie genau geht Google vor, wenn eine Straße als Klartext in einen Hashwert verwandelt wird? Wie sieht es bei anderen Diensten aus - oder anderen Adressinformationen? Dieser Post liefert Antworten auf diese Fragen und versucht, das Kosten-Nutzen-Verhältnis realistisch einzuschätzen. Weiterlesen... »