Hinweis: Dieser Beitrag stammt aus Februar 2018 und zeigt, wie interne Besuche auf WordPress-Sites über ein dataLayer-Plugin + GTM + Custom Dimensions in Universal Analytics markiert und per Datenansicht-Filter ausgeschlossen werden. Seit Juli 2023 ist UA abgeschaltet, die hier gezeigten Filter auf Datenansichten und die Custom-Dimension-Indizes gibt es so nicht mehr. Das beschriebene WordPress-Plugin und die dataLayer-Signale (wp_utype, wp_aut etc.) funktionieren aber weiter und lassen sich in GA4 über Event-Parameter, User Properties und Audiences analog nutzen. Der Beitrag bleibt als Zeitdokument erhalten.

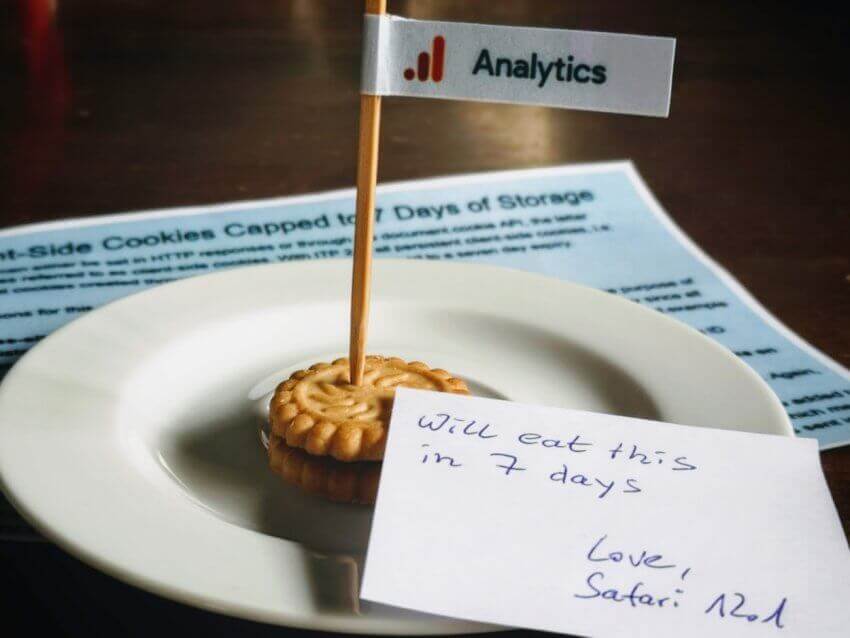

Knapp 40% aller Websites weltweit werden mit WordPress betrieben. Deren Betreiber nutzen in großer Anzahl Google Analytics zur Auswertung des Besucherverhaltens. Kein Wunder also, dass es zahlreiche Plugins rund um Integration, Reporting, Verfeinerung der Messung durch Events, E-Commerce-Transaktionen etc. gibt. Das Angebot wird dünner, wenn man sich um hiesige Besonderheiten wie IP-Anonymisierung, erweiterte Opt-Out-Funktionen oder den Dank der Anonymisierung nicht mit den üblichen IP-Filtern zu erledigende Ausschluss interner Besucher geht. Daher müssen wir uns auf verschiedenen Umwegen um Kennzeichnung interner Besucher bemühen, damit es etwas zu filtern gibt. Einen Überblick über einige Lösungen habe ich vor einiger Zeit unter www.gandke.de/ga-marker veröffentlicht, wo es auch einige Plugins für verschiedene Systeme - einschließlich WordPress - gibt.

Anreicherung des dataLayer für WordPress-Sites

Für eine vergleichsweise "kleine" Website mit einem oder wenigen Webmastern/Autoren habe ich im Sinne einer möglichst simplen Lösung ein weiteres Plugin erstellt, das im Zusammenspiel mit dem Google Tag Manager die Markierung anhand des Anmeldestatus ermöglicht. Davon ausgehend, dass i. d. R. genau dann viel "Datenmüll" entsteht, wenn man an der eigenen Website arbeitet und sonstige Aufrufe eher nicht ins Gewicht fallen, reicht dieses Merkmal vollkommen aus, um überflüssige selbstgemachte Hits ausreichend gut aus der Webanalyse zu filtern. Nebenbei wird der dataLayer des Tag Managers um ein paar weitere Informationen wie Autor, Monat und Jahr des Beitrags, Kategorien und Tags angereichert, um diese ebenfalls z. B. als benutzerdefinierte Dimension an Google Analytics zu senden.

Weiterlesen... »