Das Spam-Experiment: Referrer Spam in eTracker und Piwik Analytics

Hinweis: Dieser Beitrag entstand im November 2016 und dokumentiert ein Experiment zu Referrer-Spam in eTracker und Piwik (heute Matomo). Der Ausgangspunkt - massives Spam-Aufkommen in Universal Analytics - ist mit der Abschaltung von UA im Juli 2023 hinfällig geworden; Google Analytics 4 hat diese Angriffsfläche über das Measurement Protocol nicht mehr in der gleichen Form. Wer heute Bot- und Spam-Traffic an der Datenquelle filtern will, findet aktuellere Hinweise im Beitrag zur serverseitigen Erkennung rendernder Bots. Der Beitrag bleibt als Zeitdokument erhalten.

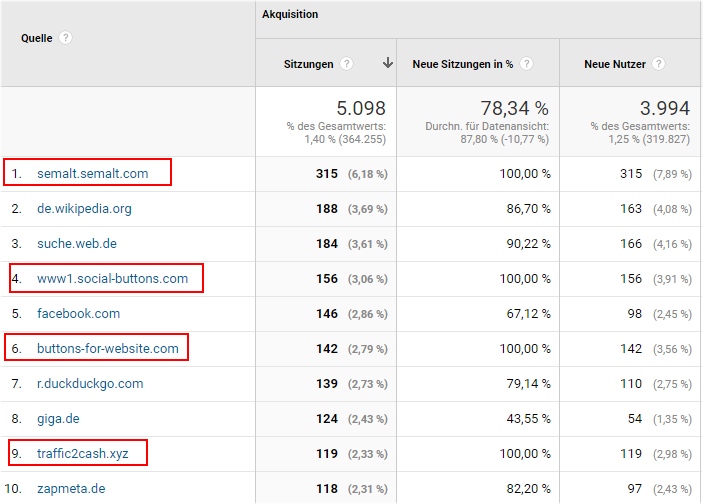

Zugegeben: Referrer Spam ist ein Google Analytics Problem. Dort finden sich in vielen ungefilterten Datenansichten solche künstlich generierten Einträge in der Liste der verweisenden Websites.

Ebenso hinterlassen Spammer automatisiert erzeugte Spuren in anderen Reports zur Webanalyse: Event-Spam, Page-Spam... und sogar im Language Report werden Daten erzeugt, die im weitesten Sinne der "Bewerbung" zweifelhafter Angebote im Web dienen sollen. Wenngleich es zahlreiche Möglichkeiten zur Behandlung dieses Leids gibt, bleibt Analytics-Spam ein Ärgernis.